大佬教程收集整理的这篇文章主要介绍了实验四 决策树算法及应用,大佬教程大佬觉得挺不错的,现在分享给大家,也给大家做个参考。

| 博客班级 | https://edu.cnblogs.com/campus/ahgc/machinelearning |

|---|---|

| 作业要求 | https://edu.cnblogs.com/campus/ahgc/machinelearning/homework/12086 |

| 作业目标 | <实验四 决策树算法及应用> |

| 学号 | <3180701112> |

1.理解决策树算法原理,掌握决策树算法框架; 2.理解决策树学习算法的特征选择、树的生成和树的剪枝; 3.能根据不同的数据类型,选择不同的决策树算法; 4.针对特定应用场景及数据,能应用决策树算法解决实际问题。

1.设计算法实现熵、经验条件熵、信息增益等方法。 2.实现ID3算法。 3.熟悉sklearn库中的决策树算法; 4.针对iris数据集,应用sklearn的决策树算法进行类别预测。 5.针对iris数据集,利用自编决策树算法进行类别预测。

1.对照实验内容,撰写实验过程、算法及测试结果; 2.代码规范化:命名规则、注释; 3.分析核心算法的复杂度; 4.查阅文献,讨论ID3、5算法的应用场景; 5.查询文献,分析决策树剪枝策略。

实验代码及截图 1.

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

%matplotlib inline

from sklearn.datasets import load_iris

from sklearn.model_SELEction import Train_test_split

from collections import Counter

import math

from math import log

import pprint

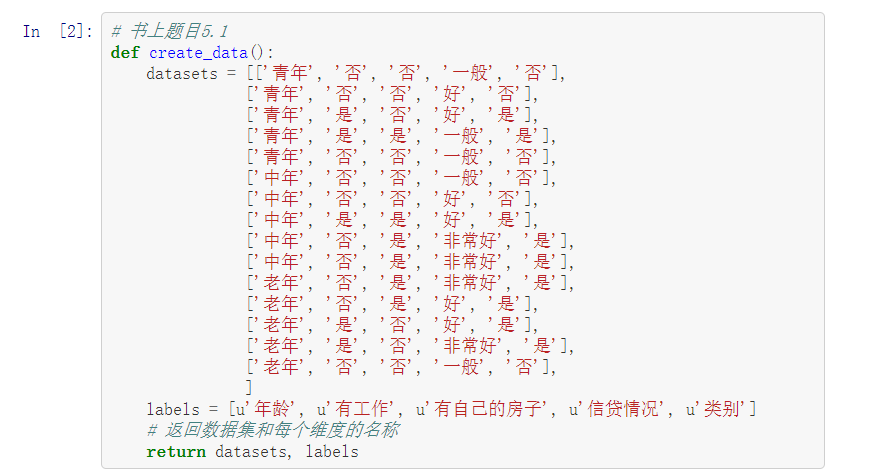

# 书上题目5.1

def create_data():

datasets = [['青年', '否', '否', '一般', '否'],

['青年', '否', '否', '好', '否'],

['青年', '是', '否', '好', '是'],

['青年', '是', '是', '一般', '是'],

['青年', '否', '否', '一般', '否'],

['中年', '否', '否', '一般', '否'],

['中年', '否', '否', '好', '否'],

['中年', '是', '是', '好', '是'],

['中年', '否', '是', '非常好', '是'],

['中年', '否', '是', '非常好', '是'],

['老年', '否', '是', '非常好', '是'],

['老年', '否', '是', '好', '是'],

['老年', '是', '否', '好', '是'],

['老年', '是', '否', '非常好', '是'],

['老年', '否', '否', '一般', '否'],

]

labels = [u'年龄', u'有工作', u'有自己的房子', u'信贷情况', u'类别']

# 返回数据集和每个维度的名称

return datasets, labels

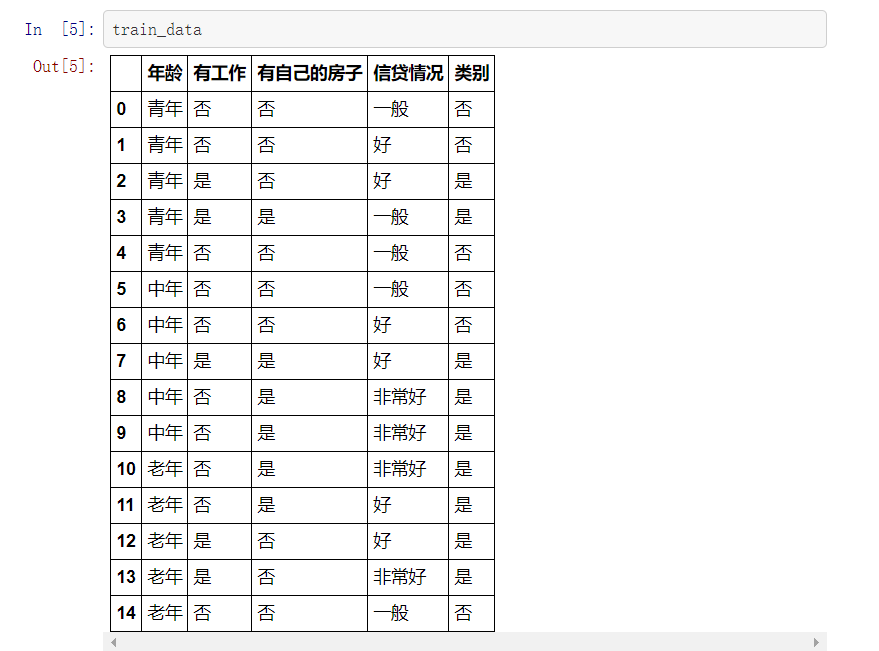

datasets, labels = create_data()

Train_data = pd.DataFrame(datasets, columns=labels)

Train_data

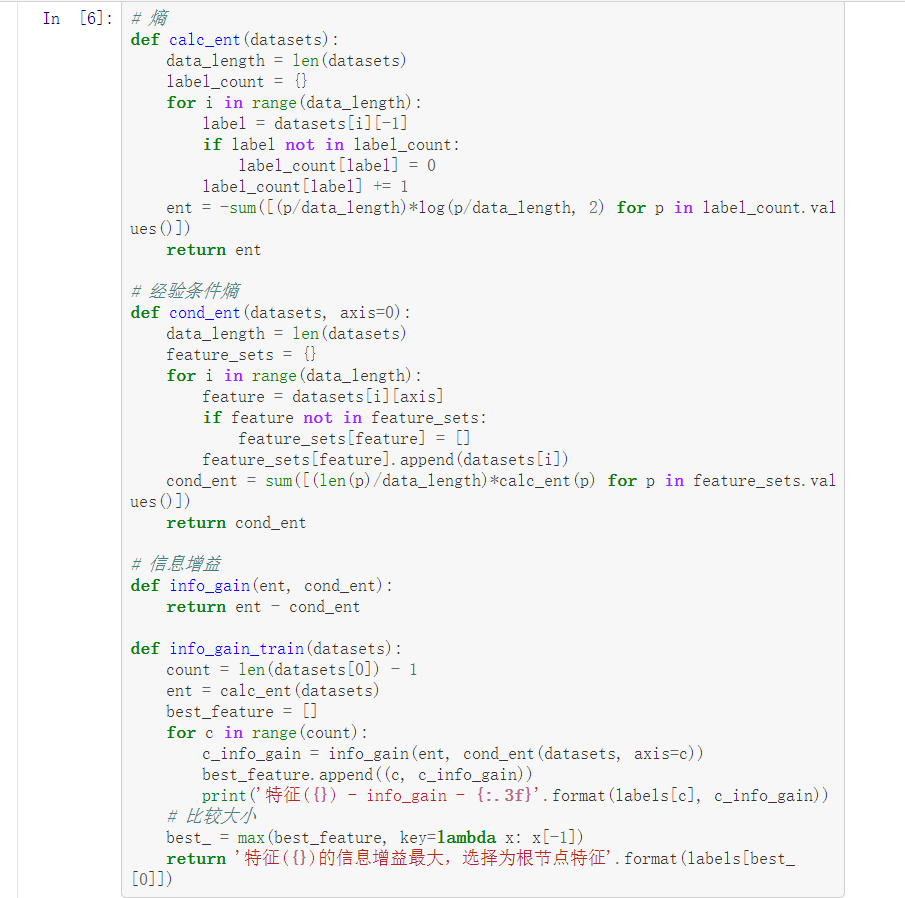

# 熵

def calc_ent(datasets):

data_length = len(datasets)

label_count = {}

for i in range(data_length):

label = datasets[i][-1]

if label not in label_count:

label_count[label] = 0

label_count[label] += 1

ent = -sum([(p/data_length)*log(p/data_length, 2) for p in label_count.values()])

return ent

# 经验条件熵

def cond_ent(datasets, axis=0):

data_length = len(datasets)

feature_sets = {}

for i in range(data_length):

feature = datasets[i][axis]

if feature not in feature_sets:

feature_sets[feature] = []

feature_sets[feature].append(datasets[i])

cond_ent = sum([(len(p)/data_length)*calc_ent(p) for p in feature_sets.values()])

return cond_ent

# 信息增益

def info_gain(ent, cond_ent):

return ent - cond_ent

def info_gain_Train(datasets):

count = len(datasets[0]) - 1

ent = calc_ent(datasets)

best_feature = []

for c in range(count):

c_info_gain = info_gain(ent, cond_ent(datasets, axis=C))

best_feature.append((c, c_info_gain))

print('特征({}) - info_gain - {:.3f}'.format(labels[c], c_info_gain))

# 比较大小

best_ = max(best_feature, key=lambda x: x[-1])

return '特征({})的信息增益最大,选择为根节点特征'.format(labels[best_[0]])

info_gain_Train(np.array(datasets))

@H_874_130@

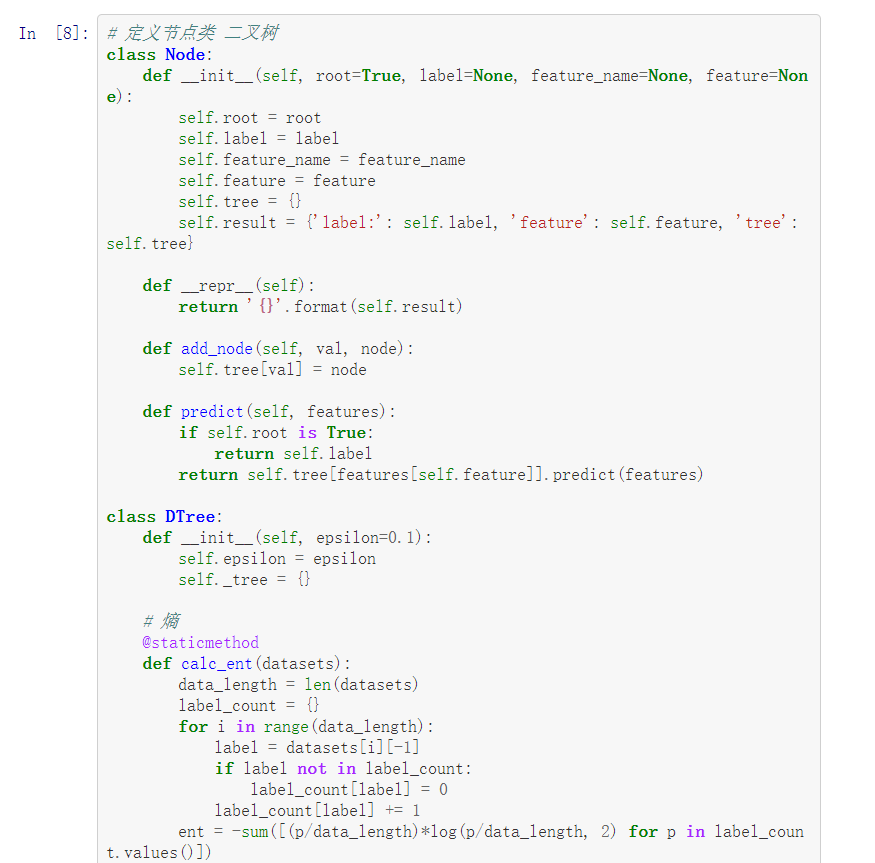

# 定义节点类 二叉树

class Node:

def __init__(self, root=True, label=None, feature_name=None, feature=NonE):

self.root = root

self.label = label

self.feature_name = feature_name

self.feature = feature

self.tree = {}

self.result = {'label:': self.label, 'feature': self.feature, 'tree': self.treE}

def __repr__(self):

return '{}'.format(self.result)

def add_node(self, val, nodE):

self.tree[val] = node

def preDict(self, features):

if self.root is True:

return self.label

return self.tree[features[self.feature]].preDict(features)

class DTree:

def __init__(self, epsilon=0.1):

self.epsilon = epsilon

self._tree = {}

# 熵

@staticmethod

def calc_ent(datasets):

data_length = len(datasets)

label_count = {}

for i in range(data_length):

label = datasets[i][-1]

if label not in label_count:

label_count[label] = 0

label_count[label] += 1

ent = -sum([(p/data_length)*log(p/data_length, 2) for p in label_count.values()])

return ent

# 经验条件熵

def cond_ent(self, datasets, axis=0):

data_length = len(datasets)

feature_sets = {}

for i in range(data_length):

feature = datasets[i][axis]

if feature not in feature_sets:

feature_sets[feature] = []

feature_sets[feature].append(datasets[i])

cond_ent = sum([(len(p)/data_length)*self.calc_ent(p) for p in feature_sets.values()])

return cond_ent

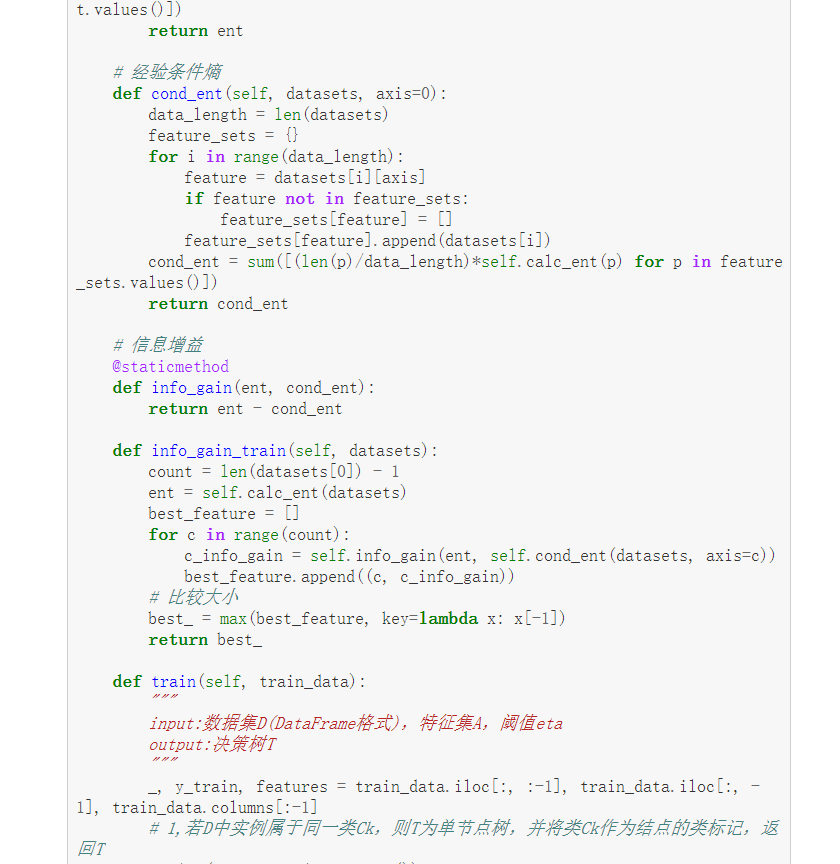

# 信息增益

@staticmethod

def info_gain(ent, cond_ent):

return ent - cond_ent

def info_gain_Train(self, datasets):

count = len(datasets[0]) - 1

ent = self.calc_ent(datasets)

best_feature = []

for c in range(count):

c_info_gain = self.info_gain(ent, self.cond_ent(datasets, axis=C))

best_feature.append((c, c_info_gain))

# 比较大小

best_ = max(best_feature, key=lambda x: x[-1])

return best_

def Train(self, Train_data):

"""

input:数据集D(DataFrame格式),特征集A,阈值eta

output:决策树T

"""

_, y_Train, features = Train_data.iloc[:, :-1], Train_data.iloc[:, -1], Train_data.columns[:-1]

# 1,若D中实例属于同一类Ck,则T为单节点树,并将类Ck作为结点的类标记,返回T

if len(y_Train.value_counts()) == 1:

return Node(root=True,

label=y_Train.iloc[0])

# 2, 若A为空,则T为单节点树,将D中实例树最大的类Ck作为该节点的类标记,返回T

if len(features) == 0:

return Node(root=True, label=y_Train.value_counts().sort_values(ascending=falsE).index[0])

# 3,计算最大信息增益 同5.1,Ag为信息增益最大的特征

max_feature, max_info_gain = self.info_gain_Train(np.array(Train_data))

max_feature_name = features[max_feature]

# 4,Ag的信息增益小于阈值eta,则置T为单节点树,并将D中是实例数最大的类Ck作为该节点的类标记,返回T

if max_info_gain < self.epsilon:

return Node(root=True, label=y_Train.value_counts().sort_values(ascending=falsE).index[0])

# 5,构建Ag子集

node_tree = Node(root=false, feature_name=max_feature_name, feature=max_featurE)

feature_list = Train_data[max_feature_name].value_counts().index

for f in feature_list:

sub_Train_df = Train_data.loc[Train_data[max_feature_name] == f].drop([max_feature_name], axis=1)

# 6, 递归生成树

sub_tree = self.Train(sub_Train_df)

node_tree.add_node(f, sub_treE)

# pprint.pprint(node_tree.treE)

return node_tree

def fit(self, Train_data):

self._tree = self.Train(Train_data)

return self._tree

def preDict(self, X_test):

return self._tree.preDict(X_test)

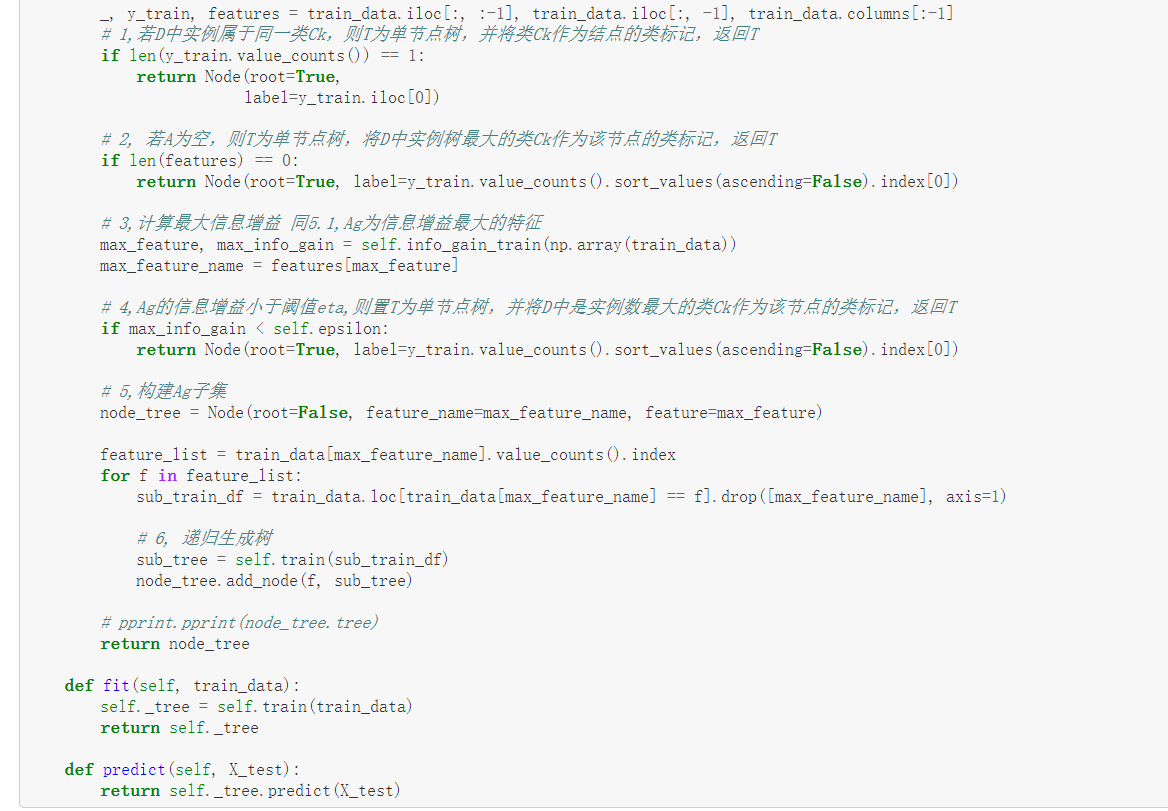

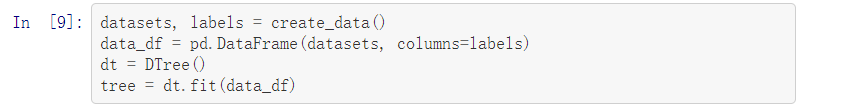

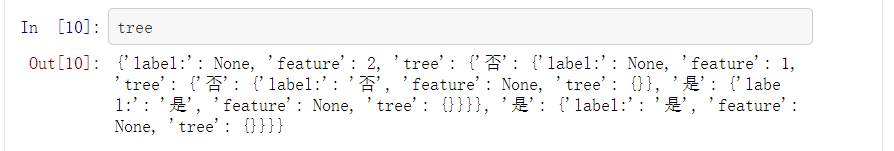

datasets, labels = create_data()

data_df = pd.DataFrame(datasets, columns=labels)

dt = DTree()

tree = dt.fit(data_df)

tree

dt.preDict(['老年', '否', '否', '一般'])

# data

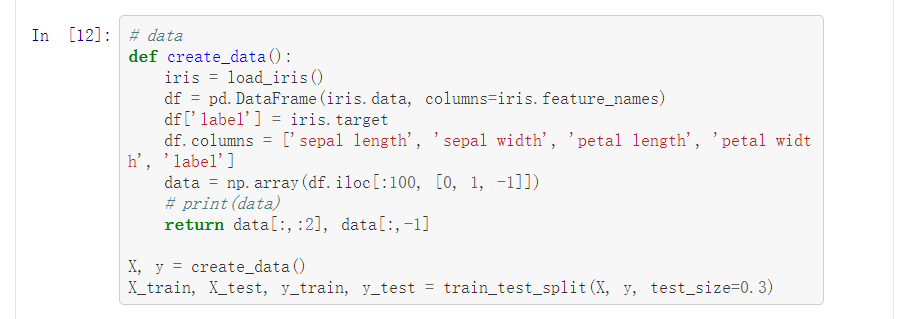

def create_data():

iris = load_iris()

df = pd.DataFrame(iris.data, columns=iris.feature_names)

df['label'] = iris.target

df.columns = ['sepal length', 'sepal width', 'petal length', 'petal width', 'label']

data = np.array(df.iloc[:100, [0, 1, -1]])

# print(data)

return data[:,:2], data[:,-1]

X, y = create_data()

X_Train, X_test, y_Train, y_test = Train_test_split(X, y, test_size=0.3)

from sklearn.tree import DecisionTreeClassifier

from sklearn.tree import export_graphviz

import graphviz

clf = DecisionTreeClassifier()

clf.fit(X_Train, y_Train,)

clf.score(X_test, y_test)

tree_pic = export_graphviz(clf, out_file="myTree.pdf")

with open('myTree.pdf') as f:

dot_graph = f.read()

graphviz.source(dot_graph)

1、讨论ID3、C4.5算法的应用场景 ID3算法应用场景: 它的基础理论清晰,算法比较简单,学习能力较强,适于处理大规模的学习问题,是数据挖掘和知识发现领域中的一个很好的范例,为后来各学者提出优化算法奠定了理论基础。ID3算法特别在机器学习、知识发现和数据挖掘等领域得到了极大发展。 C4.5算法应用场景: C4.5算法具有条理清晰,能处理连续型属性,防止过拟合,准确率较高和适用范围广等优点,是一个很有实用价值的决策树算法,可以用来分类,也可以用来回归。C4.5算法在机器学习、知识发现、金融分析、遥感影像分类、生产制造、分子生物学和数据挖掘等领域得到广泛应用。

2、分析决策树剪枝策略 (1)如何进行决策树剪枝 决策树的剪枝基本策略有 预剪枝 (Pre-Pruning) 和 后剪枝 (Post-Pruning) 。先对数据集划分成训练集和验证集,训练集用来决定树生成过程中每个结点划分所选择的属性;验证集在预剪枝中用于决定该结点是否有必要依据该属性进行展开,在后剪枝中用于判断该结点是否需要进行剪枝。 (2)预剪枝 加入预剪枝后的决策树生成流程图如下:

(3)后剪枝 对于后剪枝: 后剪枝则是先从训练集生成一颗完整的决策树,然后自底向上地对非叶结点进行考察,若将该结点对应的子树替换为叶结点能带来泛化性能提升,则将该子树替换为叶结点。 对于后剪枝,书中采用了具体的西瓜分类决策树作为剪枝操作讲解,跟着流程走下来感觉挺顺畅,无非就是对想要进行剪枝的结点进行验证集数据的准确性比较,如果剪枝能带来准确性的提高,那么就剪枝,否则保留。然后去判断其它需要考虑剪枝的结点。 在进行剪枝判断的操作中,只对底端结点进行判断。一步一步收缩至每一个底端结点对验证集数据都有更好的分类准确率为止。

以上是大佬教程为你收集整理的实验四 决策树算法及应用全部内容,希望文章能够帮你解决实验四 决策树算法及应用所遇到的程序开发问题。

如果觉得大佬教程网站内容还不错,欢迎将大佬教程推荐给程序员好友。

本图文内容来源于网友网络收集整理提供,作为学习参考使用,版权属于原作者。

如您有任何意见或建议可联系处理。小编QQ:384754419,请注明来意。