大佬教程收集整理的这篇文章主要介绍了线性分类器,大佬教程大佬觉得挺不错的,现在分享给大家,也给大家做个参考。

Softmax回归是多分类,其他都是二分类

(f(x;w,b)=w^Tx +b ,yin R)

(g(f(x;w))=begin{Cases} 1 & if f(x;w)>0\ 0& if f(x;w)<0\ end{Cases})

({(x^{(n)}),y^{(n)}}_{n=1}^{N})

(x^{(n)}in mathbb{R}^D) (y^{(n)}in{0,1})

(g(f(x;w))=begin{Cases} 1 & if f(x;w)>0\ 0& if f(x;w)<0\ end{Cases})

(0-1函数:mathcal{L}_{01}(y,g(f(x;w)))=I(yne g(f(x;w)))- 不可求导)

({(x^{(n)}),y^{(n)}}_{n=1}^{N})

(x^{(n)}in mathbb{R}^D) (y^{(n)}in{1,2,...,C},C>2)

(0-1函数:mathcal{L}_{01}(y,g(f(x;w)))=I(yne g(f(x;w)))- 不可求导)

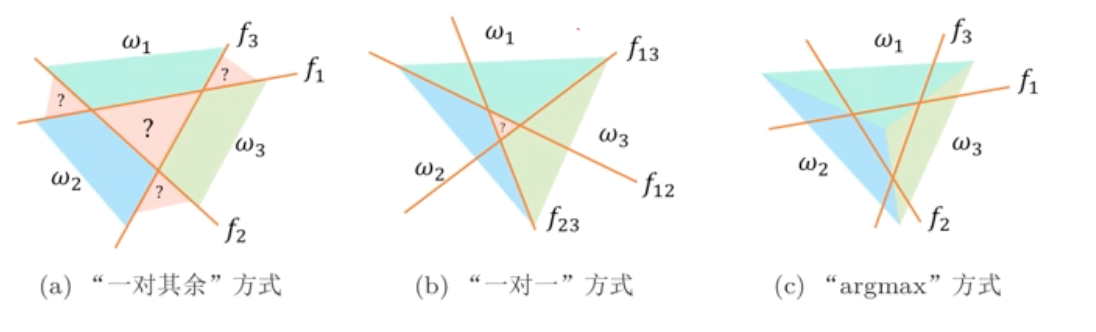

(一种改进的"一对其余"方式,共需要C个判别函数) (f_c(x;w_C)=w_c^T+b_c,cin {1,2,...,C}) ("argmax"方式的预测函数定义为) (y=argmax_{C=1}^C f_c(x;w_C))

以上是大佬教程为你收集整理的线性分类器全部内容,希望文章能够帮你解决线性分类器所遇到的程序开发问题。

如果觉得大佬教程网站内容还不错,欢迎将大佬教程推荐给程序员好友。

本图文内容来源于网友网络收集整理提供,作为学习参考使用,版权属于原作者。

如您有任何意见或建议可联系处理。小编QQ:384754419,请注明来意。